Informatique & PC

L’informatique dédiée au gaming et à l’e-sport représente bien plus qu’un simple assemblage de composants électroniques. C’est un écosystème complexe où chaque élément, du processeur aux périphériques, influence directement l’expérience de jeu et les performances compétitives. La différence entre une victoire et une défaite se mesure souvent en millisecondes, là où la latence d’une souris mal configurée ou le goulot d’étranglement d’un processeur sous-dimensionné peuvent coûter cher.

Que vous assembliez votre première machine de jeu ou cherchiez à optimiser un système existant, comprendre les principes fondamentaux de l’architecture PC, les enjeux de sécurité numérique et les techniques d’optimisation devient indispensable. Cet article vous accompagne dans cette exploration technique, des fondations matérielles aux réglages logiciels les plus pointus, en passant par les périphériques qui prolongent votre intention jusqu’à l’écran.

Les fondations : comprendre l’architecture matérielle

La construction d’un PC performant repose sur une compréhension solide de l’interaction entre les composants. Contrairement aux idées reçues, un ordinateur n’est pas qu’une simple somme de pièces puissantes : c’est un système où l’équilibre prime sur la force brute.

Les composants essentiels et leur rôle

Chaque composant remplit une fonction spécifique dans la chaîne de traitement. Le processeur (CPU) orchestre les calculs généraux et la logique du jeu, tandis que la carte graphique (GPU) se charge exclusivement du rendu visuel. La mémoire vive (RAM) stocke temporairement les données actives, permettant un accès quasi-instantané aux informations nécessaires au gameplay. Le stockage (SSD ou disque dur) conserve les fichiers de manière permanente, avec des temps de chargement variant drastiquement selon la technologie utilisée.

L’alimentation électrique, souvent négligée, constitue le cœur circulatoire du système. Une alimentation sous-dimensionnée ou de mauvaise qualité peut provoquer des instabilités, des redémarrages intempestifs, voire endommager les composants coûteux. La règle empirique conseille une marge de sécurité de 20 à 30% au-dessus de la consommation théorique totale du système.

Planification et compatibilité

L’assemblage PC ressemble à un puzzle tridimensionnel où les incompatibilités physiques guettent. La carte mère détermine le socle de compatibilité : socket du processeur, génération de RAM supportée, connecteurs d’extension disponibles. Un processeur Intel récent ne s’installera jamais sur une carte mère AMD, et inversement.

Le boîtier doit accueillir tous ces éléments avec suffisamment d’espace pour la circulation d’air. Une carte graphique haut de gamme peut mesurer plus de 30 centimètres et occuper trois emplacements d’extension. Planifier l’espace disponible évite les mauvaises surprises lors de l’assemblage et garantit un flux d’air optimal pour le refroidissement. Une température maîtrisée prolonge la durée de vie du matériel et préserve les performances sous charge intensive.

Hardware haute performance : investir intelligemment

L’investissement dans les composants haute performance doit répondre à des besoins réels plutôt qu’à une course aux spécifications maximales. Comprendre les véritables goulots d’étranglement de votre usage permet d’optimiser le budget.

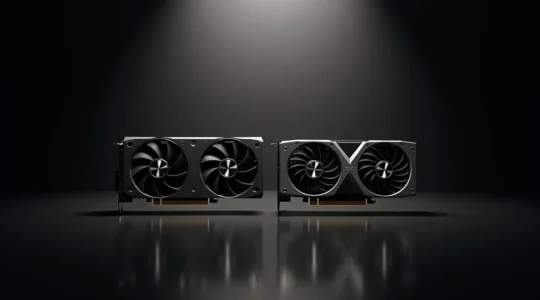

Carte graphique et rendu en haute résolution

Pour le rendu 4K natif, la quantité de VRAM (mémoire vidéo) devient critique. Les textures haute définition et les effets graphiques modernes saturent rapidement une mémoire insuffisante, provoquant des baisses de framerate brutales. Une carte avec 8 Go de VRAM représente un minimum raisonnable pour du gaming en 1440p, tandis que la 4K exige plutôt 12 Go ou plus selon les titres.

Les modèles custom, également appelés modèles AIB (Add-In Board), proposent des systèmes de refroidissement améliorés, des fréquences d’horloge supérieures et parfois des circuits d’alimentation renforcés. Ils génèrent moins de bruit et maintiennent des températures plus basses que les modèles de référence, au prix d’un encombrement accru et d’une facture plus salée.

Processeur, RAM et équilibre du système

Le goulot d’étranglement (bottleneck) survient lorsqu’un composant limite les performances d’un autre. Un processeur trop faible ne pourra pas nourrir une carte graphique puissante en instructions suffisamment rapidement, gaspillant son potentiel. À l’inverse, un CPU haut de gamme couplé à un GPU d’entrée de gamme représente un déséquilibre budgétaire inefficace.

La RAM joue un rôle souvent sous-estimé. Au-delà de la quantité (16 Go constituent le standard actuel pour le gaming), la fréquence et la latence influencent les performances, particulièrement sur les processeurs AMD récents. Les profils XMP (Intel) ou EXPO (AMD) permettent d’activer facilement les fréquences certifiées par le fabricant, mais nécessitent une validation de stabilité après activation.

Périphériques et latence : la précision millimétrique

L’interface homme-machine représente le dernier maillon de la chaîne de performance. Un système informatique puissant ne révèle son plein potentiel que couplé à des périphériques réactifs et ergonomiquement adaptés.

Comprendre l’impact de la latence périphérique

La latence périphérique mesure le délai entre votre action physique et sa prise en compte par le jeu. Elle se décompose en plusieurs étapes : temps de réponse du capteur, traitement par le microcontrôleur interne, transmission via le câble ou la connexion sans fil, traitement par le pilote système, puis par le jeu lui-même.

Dans les disciplines e-sport exigeantes comme les FPS compétitifs ou les jeux de rythme, une latence totale inférieure à 10 millisecondes fait la différence entre un tir parfaitement ajusté et un échec cuisant. Les souris filaires offrent généralement une latence inférieure aux modèles sans fil, bien que les technologies propriétaires récentes réduisent considérablement cet écart.

La configuration logicielle influence également cette latence. Des pilotes obsolètes, un polling rate mal réglé ou des effets d’accélération de souris non désirés ajoutent des microretards imperceptibles individuellement mais cumulatifs dans l’expérience globale. Identifier et corriger ces erreurs de configuration libère instantanément du potentiel de performance.

Ergonomie et adaptation morphologique

Un périphérique techniquement irréprochable mais inadapté à votre morphologie causera fatigue et perte de précision après quelques heures d’utilisation. La taille de la main, le style de prise (palm grip, claw grip, fingertip grip) et même la position du poignet déterminent le design optimal.

Les signes d’usure affectent progressivement la performance : patins de souris abîmés augmentant la friction, switchs mécaniques de clavier perdant leur point d’activation précis, ou revêtement dégradé compromettant la préhension. Un remplacement préventif des éléments usés maintient une cohérence dans l’expérience de jeu et préserve la mémoire musculaire développée au fil des sessions.

Optimisation logicielle et outils du joueur

Le matériel le plus performant reste bridé sans une configuration logicielle appropriée. L’optimisation système et les outils d’analyse complètent l’arsenal du joueur exigeant.

La configuration système englobe plusieurs aspects : pilotes graphiques à jour pour bénéficier des dernières optimisations spécifiques aux jeux récents, désactivation des processus d’arrière-plan inutiles consommant des ressources, réglages de gestion d’alimentation favorisant les performances plutôt que l’économie d’énergie. Ces ajustements libèrent des ressources processeur et mémoire pour l’application prioritaire : le jeu.

Les outils analytiques légaux offrent des perspectives précieuses sur les performances et la progression. Dans les jeux compétitifs, les HUD (heads-up display) personnalisés affichent des métriques en temps réel : framerate, latence réseau, utilisation CPU/GPU. Pour certaines disciplines comme le poker en ligne, des logiciels spécialisés permettent d’importer l’historique des mains et d’analyser les courbes de gains, identifiant les points forts et les axes d’amélioration.

Le choix d’un outil éthique respectant les conditions d’utilisation des plateformes reste primordial. La dépendance excessive aux assistants logiciels peut également nuire au développement des compétences naturelles. L’outil doit rester un moyen d’apprentissage, jamais une béquille permanente.

Cybersécurité : protéger son environnement de jeu

La sécurité du compte joueur dépasse largement la simple protection d’un pseudonyme. Elle englobe la sauvegarde de données personnelles, de moyens de paiement et parfois d’actifs virtuels ayant une valeur monétaire réelle.

La gestion des mots de passe constitue la première ligne de défense. Un mot de passe unique et complexe pour chaque plateforme, stocké dans un gestionnaire dédié plutôt que dans la mémoire du navigateur, réduit drastiquement les risques de compromission en cascade. L’authentification à deux facteurs ajoute une couche de protection même en cas de vol du mot de passe principal.

Les protocoles de cryptage sécurisent les communications entre votre machine et les serveurs de jeu. Vérifier la présence du cadenas HTTPS dans la barre d’adresse avant toute opération sensible garantit que les données transitent de manière chiffrée. Les plateformes légitimes investissent massivement dans ces technologies de protection.

Le phishing ciblé représente une menace croissante. Des emails ou messages imitant parfaitement les communications officielles tentent de dérober identifiants et informations bancaires. Vérifier systématiquement l’adresse d’expédition, ne jamais cliquer sur des liens suspects et consulter directement le site officiel en cas de doute constituent des réflexes salvateurs. Pour les plateformes financières ou de jeu d’argent, la vérification des licences d’opérateur auprès des autorités compétentes confirme la légitimité du service.

Overclocking : performance gratuite mais exigeante

L’overclocking offre des gains de performance sans investissement matériel supplémentaire, en poussant les composants au-delà de leurs spécifications d’usine. Cette pratique exige toutefois rigueur et surveillance.

Principes et loterie du silicium

Chaque puce de silicium présente des variations microscopiques héritées du processus de fabrication. Deux processeurs identiques en apparence peuvent tolérer des fréquences maximales différentes : c’est la loterie du silicium. Certaines unités acceptent des overclocks importants sans broncher, tandis que d’autres atteignent leurs limites rapidement.

Les gains varient selon les composants et les usages. Un processeur overclocké peut offrir 10 à 20% de performances supplémentaires dans les tâches exploitant tous les cœurs. La RAM overclock améliore particulièrement les frametimes dans les jeux, réduisant les micro-saccades. La carte graphique, déjà optimisée par le fabricant, offre généralement des marges plus limitées.

Stabilité, surveillance et risques

L’overclocking accroît la consommation électrique et la production de chaleur. Les outils de stress test comme Prime95 pour le CPU ou FurMark pour le GPU soumettent les composants à des charges extrêmes pendant plusieurs heures, révélant toute instabilité avant qu’elle ne survienne en situation réelle.

La surveillance des températures en charge prévient la dégradation prématurée. Les processeurs modernes tolèrent des températures élevées (80-90°C sous charge), mais des valeurs constamment maximales réduisent leur longévité. Un refroidissement adéquat, qu’il soit à air ou liquide, permet de maintenir des températures saines tout en profitant des fréquences élevées.

Les profils XMP/EXPO pour la RAM constituent une forme d’overclocking pré-configuré, testé et certifié par le fabricant. Leur activation dans le BIOS offre un gain immédiat avec un risque minimal, à condition de vérifier la stabilité système après application. Un démarrage qui échoue peut nécessiter une réinitialisation CMOS pour revenir aux paramètres d’origine.

Maîtriser son environnement informatique pour le gaming compétitif demande un apprentissage progressif, de l’architecture matérielle aux subtilités logicielles. Chaque optimisation, chaque composant judicieusement choisi, chaque réglage affiné contribue à transformer une machine ordinaire en outil de précision. L’investissement en connaissances rapporte bien au-delà de l’investissement financier, permettant d’exploiter pleinement le potentiel de chaque configuration et d’adapter le système à l’évolution de vos besoins et de vos ambitions compétitives.

Overclocking manuel ou automatique : lequel garantit la stabilité système pour un usage quotidien ?

Contrairement à une idée reçue, l’overclocking automatique n’est pas le choix le plus sûr pour la stabilité et la longévité de votre processeur au quotidien. Les algorithmes automatiques appliquent souvent des tensions (Vcore) inutilement élevées, accélérant la dégradation silencieuse du…

Lire la suite

RTX 4090 ou RX 7900 XTX : laquelle justifie son prix pour du gaming 4K sans compromis ?

Choisir entre la RTX 4090 et la RX 7900 XTX pour le gaming 4K ultime n’est pas une simple comparaison de FPS, mais une décision sur l’ensemble de l’écosystème PC et le coût total de l’investissement. La RTX 4090 offre…

Lire la suite

Authentification double facteur (2FA) ou clé physique : quel niveau de protection pour un compte à 5000 € ?

La sécurité de votre compte de jeu à 5000€ ne dépend pas d’un seul outil, mais de la construction d’un écosystème de défense en couches qui isole vos informations. La protection d’un compte ne se limite pas au mot de…

Lire la suiteTracker statistique ou solveur GTO : quel outil prioriser pour l’analyse post-session ?

La performance au poker ne réside pas dans le choix entre un tracker et un solveur, mais dans la compréhension de leur synergie au sein d’une boucle d’analyse continue. Le tracker statistique agit comme un diagnosticien : il identifie les…

Lire la suite

Custom loop vs AIO 360mm : le guide ultime pour refroidir un CPU overclocké

La supériorité d’un refroidissement pour CPU overclocké ne se mesure pas à sa performance brute, mais à sa capacité à gérer la charge thermique globale de l’ensemble du système. La performance de refroidissement est directement impactée par des composants inattendus…

Lire la suite

Clavier mécanique ou optique : lequel choisir pour gagner 15ms de réactivité sur CS2 ?

Gagner 15ms de réactivité sur CS2 ne dépend pas d’un simple choix entre clavier mécanique et optique, mais de l’élimination des goulots d’étranglement sur toute votre chaîne de latence. La latence d’un switch usé ou d’un pilote obsolète peut annuler…

Lire la suite